22 de Agosto de 2025

4 MINUTOS DE LECTURA

Las herramientas de inteligencia artificial generan más riesgos que beneficios para los sistemas democráticos, pues permiten alterar la percepción de la realidad y convertir la sobreinformación en desinformación.

Por Antonieta Sánchez S.

En 2024 el Tribunal Constitucional de Rumania anuló el resultado de la primera vuel ta presidencial, que ganó el candidato de ultraderecha Calin Georgescu. ¿El motivo? Evidencia de manipulación de votos a través de redes sociales, financiamiento ilegal de campañas en TikTok, ciberataques orquestados por fuerzas externas y presunta injerencia rusa.

Una investigación indicó que 25 mil cuentas de TikTok pro Georgescu se volvieron muy activas dos semanas antes de la elección; y que se usaron influencers pagados para promocionarlo. Como resultado, Georgescu, que partió con un apoyo de solo un dígito, logró imponerse con el 22,9%.

El caso pone de relieve el impacto que las campañas de desinformación por redes sociales pueden tener en la opinión pública y la amenaza que supone la intervención de Estados extranjeros en elecciones democráticas. Además, evidencia la necesidad de un marco regulatorio más sólido y mayor supervisión y transparencia por parte de las principales plataformas.

Desafíos regulatorios

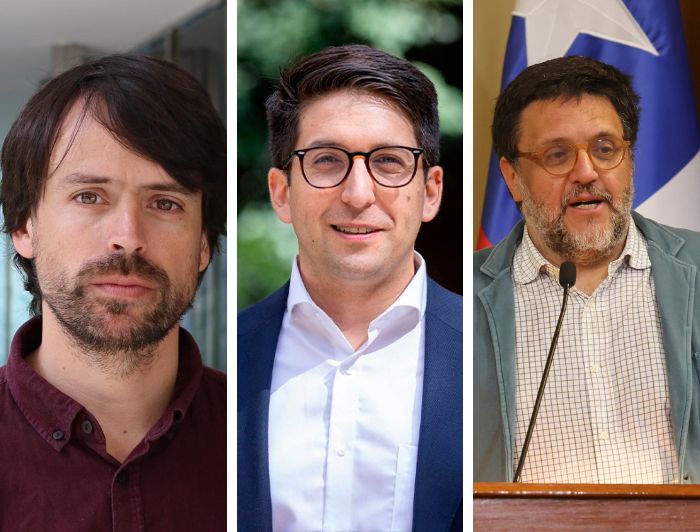

En Chile, que está en pleno periodo electoral, el tema despierta inquietud. Matías Aránguiz, subdirector del Programa de Derecho, Ciencia y Tecnología UC, plantea un diagnóstico poco auspicioso. No hay mucho que hacer, declara. “El gran problema es que, si bien tenemos definido el problema y podemos identificar principios jurídicos detrás de la regulación, no tenemos herramientas eficaces”. No somos conscientes de que, al “informarnos”, accedemos a contenido que está condicionado por la intermediación algorítmica de la IA.

En efecto, los países con alguna regulación no están en mejores condiciones que los que no. “No tenemos ninguna idea de cómo hacer persecución en contextos digitales en ninguna parte del mundo; nos faltan años luz de poder perseguir a un delincuente digital”, sostiene.

“El gran éxito de la intermediación algorítmica de la IA es que no somos conscientes de que estamos recibiendo la información a través de canales intermediados. Pensamos ingenuamente que estamos accediendo a la única información posible, y estamos accediendo a una que está condicionada por muchos elementos”, Rafael Rubio, académico Universidad Complutense de Madrid.

Alberto Coddou, profesor de la Escuela de Gobierno y de College, coincide en que no está clara la magnitud del impacto de la IA en los procesos electorales: “El 2024 más de 2 mil millones de personas votaron en el mundo. Muchos de los institutos que estudian este problema a nivel internacional no fueron capaces de dar cuenta con evidencia empírica cuál fue el impacto real de los deepfakes, de la desinformación o el microtargeting algorítmico en esas elecciones”.

Dice que, si bien los países han robustecido sus regulaciones, el impacto de la IA es mucho más difuso y difícil de fiscalizar: “Opera generando un clima general de desconfianza. Hay una fatiga frente a un exceso de información que hace perder la credibilidad en el contenido que se consume para informarse de las elecciones”.

Rafael Rubio, académico de Derecho Constitucional de la Universidad Complutense de Madrid, dijo en un seminario organizado por la UC que el gran éxito de la intermediación algorítmica de la IA es que no somos conscientes de que estamos recibiendo la información a través de canales intermediados. “Pensamos ingenuamente que estamos accediendo a la única información posible, y estamos accediendo a una que está condicionada por muchos elementos”, indicó.

Organismos como la ONU y la OEA han emitido orientaciones para que se generen regulaciones que ayuden a un voto libre e informado. Es un punto de partida, sostiene Coddou, pero también hay aspectos menos explorados: “Tenemos que regular, limitar, poner líneas rojas, pero también pensar fuera de la caja en cuál es la crisis que está detrás. Hay una crisis de la democracia”.

En contraposición, el profesor Aránguiz declara no tener propuestas para revertir los riesgos de la IA. “Tengo aspiraciones: que la gente leyera más, que viera los medios de comunicación tradicional, que escuchara la radio, que viera los debates de la tele y que viera menos reels. Pero es poco realista. El problema es que tenemos una sociedad donde la recepción de información es a través de redes sociales, donde no tenemos ningún control editorial”.